こんにちは。ナレコム前川です。

今回はMicrosoft公式にあるチュートリアル Holograms 212 Voice 1章 Awareness を進めていきたいと思います。

Holograms 212では次のスキルを習得していきます。

第一章 認知 音声コマンドについての説明

第二章 確認応答 マイク入力でメッセージを録音しユーザにフィードバック

第三章 理解と Dictation Recognizer Dictation Recognizerを使用し予測と最終結果を表示

第四章 Grammar Recognizer Grammar Recognizerを使用しユーザの発音内容を認識する

準備

まずはこちらのファイルをクローンしてください。

私が使用したOSやアプリケーション等のバージョンは以下の通りです。

- windows 10

- Unity 5.5.3f1

- Visual Stadio 2015

- GitHubのファイルのバージョン:f38979ca3952ae96c90f24a9b6acaaec181ae15e

ダウンロードしたファイルをすべて展開しておきます。

Unityを起動し、[Open Project]をクリックします。

[Open]をクリックし、HolographicAcademy-Holograms-212-Voiceフォルダを探します。

HolographicAcademy-Holograms-212-Voiceフォルダ内の[Starting]フォルダに移動し、[ModelExplorer]フォルダを選択します。

[Project]パネルでSceneフォルダを選択し、[ModelExplorer]シーンをダブルクリックしてUnityを開きます。

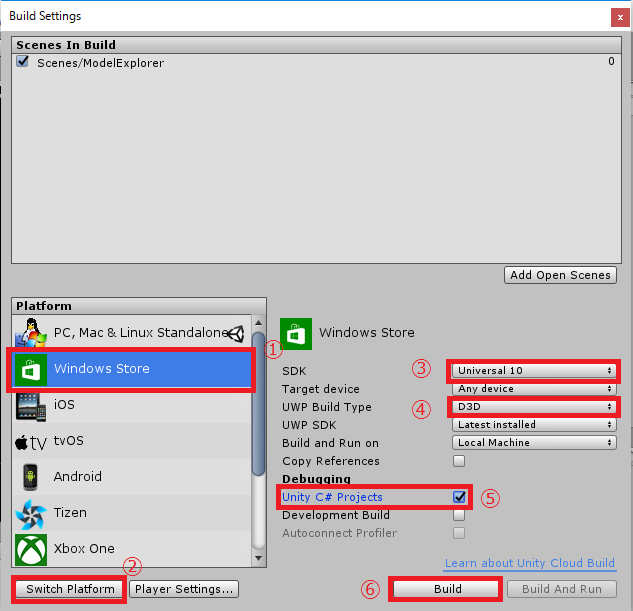

次に、上部ツールバーから[File] -> [Build Setting] を選択します。

※[Scene Build]の中に[Scenes/ModelExplorer]がない場合は、[Add Open Scenes]をクリックして追加してください。

Build Settingでは6つの作業を行います。

1. [Windows Store]を選択。

2.[Switch Platform]をクリック。

3.[SDK]を[Universal 10]に変更。

4.[UWP Build Type]を[D3D]に変更。

5.[Unity C# Projects]にチェックを入れる。

6.[Build]をクリック。

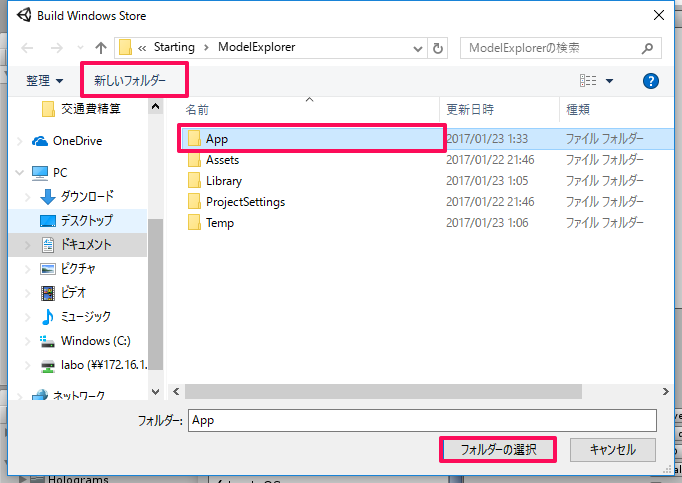

Buildクリック後、フォルダが開くので”App”というフォルダを作成します。

作成したら[App]フォルダを選択します。

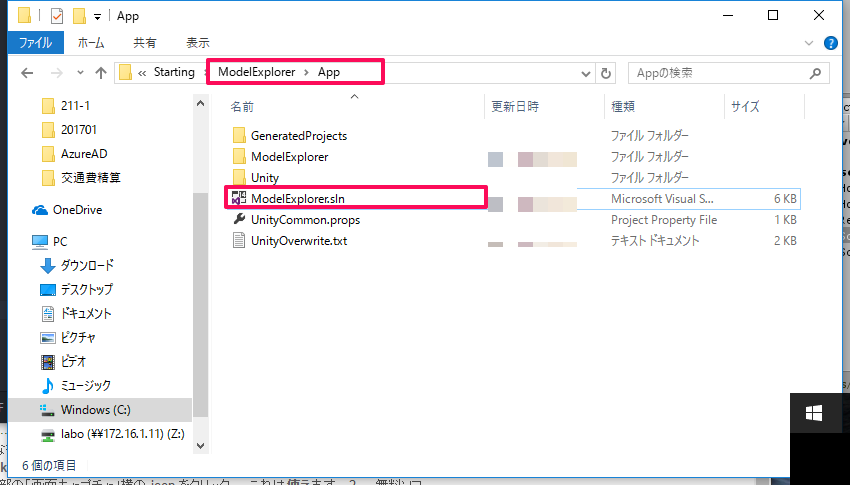

[App]フォルダを開き、[ModelExplorer Visual Studio Solution]をVisual Stadioで開きます。

1. [Debug] -> [Release]に変更し、[ARM] -> [x86]に変更します。

2. [デバイス]ボタンを[リモート コンピューター]に変更します。

デバイスのIPアドレスを入力し、[認証モード]を[ユニバーサル]に設定します。

メニューで [デバッグ]、[デバッグなしで開始] の順に選択するか、Ctrl + F5で実行します。

第1章 Awareness

それでは、第一章を進めて行きたいと思います。

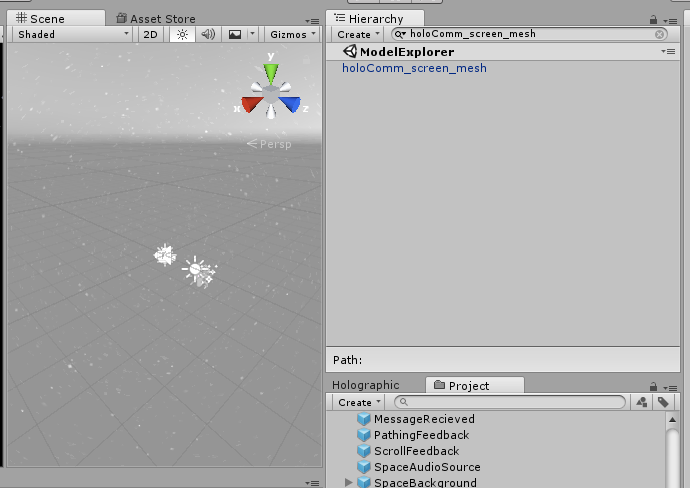

Unityの[Hierarchy]パネルの検索ツールを使用して、

[holoComm_screen_mesh]を探してダブルクリックし、[Scene]で表示します。

[Inspector] パネルで [Keyword Manager (Script)] コンポーネントに移動します。

[Keyword Manager (Script)]にある[Keywords and Responses]をクリックし、

サポート対象の音声コマンドである”Open Communicator”を確認します。

Keyword ManagerスクリプトをVisual Stadioで開きます。

KeywordManager.csを調べ、KeywordRecognizerを使用して

音声コマンドを追加する方法とデリゲートを使用してコマンドに応答する方法を理解します。

配置とビルド

次に、ビルドと配置を行います。

[デバッグ]、[デバッグなしで開始] の順に選択するか、Ctrl + F5で実行します。

アプリを配置したら、ジェスチャーで空中をタップします。

宇宙飛行士の腕時計に視線を送るとカーソルがマイクに変わります。

腕時計に視線を送りながら、「Open Communicator」と発音するとコミュニケーターパネルが開きます。

カーソルがマイクに変わることで、アプリの音声コマンドを聞いているというフィードバックを提供しています。

また、腕時計にツールチップが表示されることで、

ユーザは「Open Communicator」コマンドを認知することができます。

アプリを実行した際の画像はこちらです。

第一章はこれで以上です。お疲れ様でした。